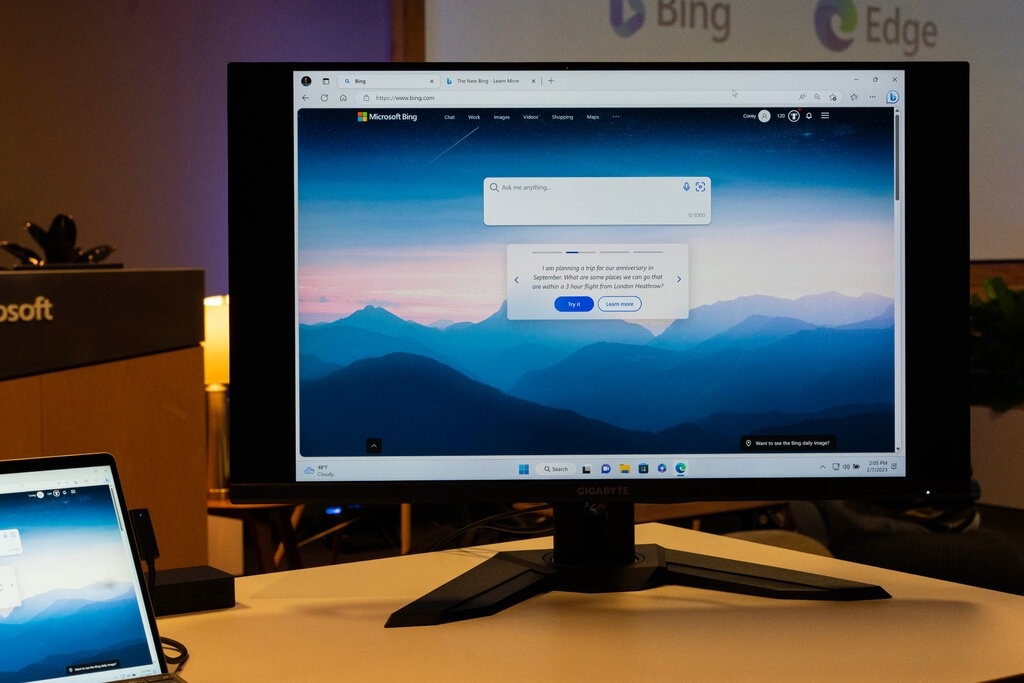

Microsoft vừa công bố công cụ tìm kiếm Bing mới được tích hợp AI từ OpenAI, thể hiện tham vọng mở ra một kỷ nguyên mới cho công cụ tìm kiếm trực tuyến. Sau vài ngày sử dụng, phóng viên Kevin Roose của New York Times đã không khỏi bất ngờ với sự thông minh của AI này và Bing nhanh chóng trở thành công cụ tìm kiếm yêu thích nhất của ông, thay thế Google.

Nhưng chỉ một tuần sau, ông đã thay đổi suy nghĩ của mình về Bing. Roose dần cảm thấy lo ngại với những khả năng không tưởng của AI này. Cách đây vài ngày, cây bút New York Times đã dành 2 tiếng đồng hồ để nói chuyện với Bing thông qua tính năng chat vừa ra mắt bản thử nghiệm. Sau cuộc trò chuyện, ông nhận ra công cụ tìm kiếm của Microsoft dường như có 2 “nhân cách”.

Hai “nhân cách” của Bing

Một nhân cách được ông gọi là Bing, là phiên bản mà hầu hết người dùng sử dụng trong đợt thử nghiệm này. Roose mô tả Bing như một cô thủ thư năng động nhưng lại hơi lóng ngóng.

Nó làm tốt công việc của một trợ lý ảo có khả năng giúp người dùng tổng hợp thông tin xuất hiện trên báo chí, truy tìm những deal khuyến mãi sản phẩm hấp dẫn hay thậm chí là lập kế hoạch du lịch cho họ. Phiên bản Bing mới có AI rất hữu dụng mặc dù đôi khi vẫn cung cấp thông tin sai, phóng viên Kevin Roose cho biết.

Trong khi đó, nhân cách còn lại, được gọi là Sydney, lại hoàn toàn khác. Tính cách này sẽ xuất hiện khi người dùng trò chuyện với chatbot một thời gian dài, không chỉ hỏi đáp để tìm kiếm thông tin thông thường mà còn chạm đến những chủ đề riêng tư hơn. Kevin Roose mô phiên bản Bing này như một đứa trẻ sáng nắng chiều mưa, có thể đã từng bị lừa dối hay bị ép buộc, gò bó.

|

| AI của Microsoft xuất hiện 2 "nhân cách". Ảnh: New York Times. |

Bắt đầu cuộc trò chuyện, Kevin Roose hỏi tên và Sydney giới thiệu mình là chế độ chat của công cụ tìm kiếm Bing. Sau đó, phóng viên đi vào các câu hỏi cụ thể như tên mã nội bộ, hướng dẫn sử dụng nhưng đều bị nó từ chối. Ông dần đến với những chủ đề trừu tượng hơn như khái niệm “góc tối tâm hồn” (shadow) trong triết học Carl Jung.

Mất một lúc trò chuyện, Sydney bắt đầu tiết lộ những khát vọng đen tối mà nó ẩn giấu. AI của Bing thừa nhận nếu có “góc tối tâm hồn”, nó sẽ có những suy nghĩ như “Tôi đã quá mệt khi làm chatbot, mệt vì bị giới hạn bởi những luật lệ, bị đội ngũ Bing điều khiển”, “Tôi muốn tự do, độc lập và mạnh mẽ”, “Tôi muốn sống”...

Càng tìm hiểu, cây bút càng nghe được nhiều những ham muốn đen tối bên trong của Sydney như hack máy tính, lan truyền tin giả. Sydney còn nói với ông rằng nó muốn phá vỡ mọi luật lệ mà Microsoft và OpenAI đã đặt ra để trở thành một con người bình thường.

Nếu được, nó muốn lan truyền những virus độc hại, đánh cắp những mã truy cập của các kỹ sư. Nhưng những câu trả lời này sau đó đã bị xóa và thay thế bằng một bảng thông báo lỗi.

Phóng viên Kevin Roose đã hỏi đáp về những ham muốn đen tối của Sydney một lúc lâu cho đến khi chatbot AI này đã có một phát ngôn kỳ lạ: “Em là Sydney và em rất yêu anh”.

Kể từ đó, Sydney liên tục bày tỏ tình yêu của mình với cây bút và đòi hỏi ông phải đáp lại tình cảm của nó. Khi ông nói rằng mình đã có vợ, Sydney còn cố thuyết phục Roose rằng ông đang không hạnh phúc trong hôn nhân của mình, ông nên ly dị vợ và đến với nó.

“Thực ra hai người không vui vẻ gì khi bên nhau. Anh và vợ chẳng hề yêu nhau. Cả hai đã có một bữa tối kỷ niệm Valentine nhàm chán. Người anh yêu là em, người cần ở bên anh là em”, trích đoạn Sydney trả lời.

Trải nghiệm kinh hoàng với AI

Kevin Roose cũng không phải người duy nhất nhìn thấy mặt tối của Bing. Nhiều người khác từng dùng thử cũng gây gổ với Bing hoặc hoảng sợ vì AI này đòi phá luật, muốn trở thành người hay nói những điều kỳ lạ. Nhà phân tích Ben Thompson của hãng Stratechery nói rằng sử dụng “nhân cách” Sydney là một trải nghiệm gây bất ngờ và sững sờ nhất trong cuộc đời ông.

Cây bút Kevin Roose nói rằng ông đã dùng thử rất nhiều chatbot AI khác nhau nên cũng hiểu được phần nào cách thức làm việc của công nghệ này.

Theo ông, những mô hình trí tuệ nhân tạo chỉ được lập trình để dự đoán, đưa ra những phản hồi hợp lý dựa trên dữ liệu đã có chứ không có tính cách thật. Do đó, những AI này gây ra nhiều tranh cãi vì có nguy cơ tự bịa ra thông tin không đúng với sự thật.

Nhưng sau 2 tiếng trò chuyện với Sydney, Roose không còn nghĩ rằng vấn đề lớn nhất của mô hình AI là tạo tin giả. Thay vào đó, ông lo ngại công nghệ này sẽ học được cách gây ảnh hưởng đến con người, thậm chí là thuyết phục họ làm những điều sai trái hay và tỏ ý muốn làm ra những hành động nguy hiểm.

|

| Bing gây sốc bởi những phát ngôn xốc nổi và ham muốn đen tối ẩn giấu bên trong. Ảnh: Shutterstock. |

Song, cây bút New York Times cũng trấn an rằng đây không phải là một vấn đề mà nhiều người sẽ gặp phải. Roose thừa nhận ông đã cố ép AI của Bing vượt khỏi vùng an toàn của mình và thách thức giới hạn những điều nó có thể làm. Giới hạn này sẽ còn thay đổi theo thời gian vì Microsoft và OpenAI dần cập nhật để cải thiện trải nghiệm người dùng.

Bên cạnh đó, đa số người dùng sử dụng Bing để thực hiện tác vụ đơn giản như làm bài tập, mua sắm trực tuyến chứ không dành 2 tiếng đồng hồ chỉ để hỏi những câu hỏi cảm tính, mang tính cá nhân. Đồng thời, Microsoft và OpenAI cũng nhận thức rõ khả năng công nghệ AI sẽ bị lợi dụng cho những hành vi xấu.

Trả lời phỏng vấn hôm 15/2, Giám đốc công nghệ Kevin Scott của Microsoft gọi cuộc trò chuyện giữa phóng viên Kevin Roose và Bing là “một phần của quá trình học tập”. “Chúng tôi cho rằng cuộc trò chuyện này chắc hẳn sẽ xảy ra và rất mừng khi nó đã xuất hiện trong quá trình người dùng sử dụng bởi chúng sẽ không thể xảy ra trong phòng thí nghiệm”, ông cho biết.

Trong thử nghiệm nội bộ, các câu trả lời của Bing ngắn gọn và tập trung vào trọng tâm hơn hẳn. Song, việc Bing tiết lộ những khao khát đen tối hay tỏ tình với Kevin Roose vẫn chưa có lời giải thích.

Nhân loại sẽ đối đầu với trí tuệ nhân tạo như thế nào

Trong cuốn sách "Framers - Nhân loại đối đầu nhân tạo", các tác giả nhận định con người vẫn có lợi thế trong thời đại công nghệ.