Deepfake đôi lúc chỉ đơn thuần là trò đùa vui vẻ, nhưng rất nguy hiểm nếu bị lạm dụng vào mục đích xấu. Hình ảnh, video, âm thanh do AI tạo ra có thể được sử dụng để gây nhầm lẫn hoặc đánh lừa mọi người.

Để góp phần ngăn chặn việc này, Microsoft vừa tung ra 2 công nghệ mới, nhằm giúp người dùng phân biệt thật giả.

|

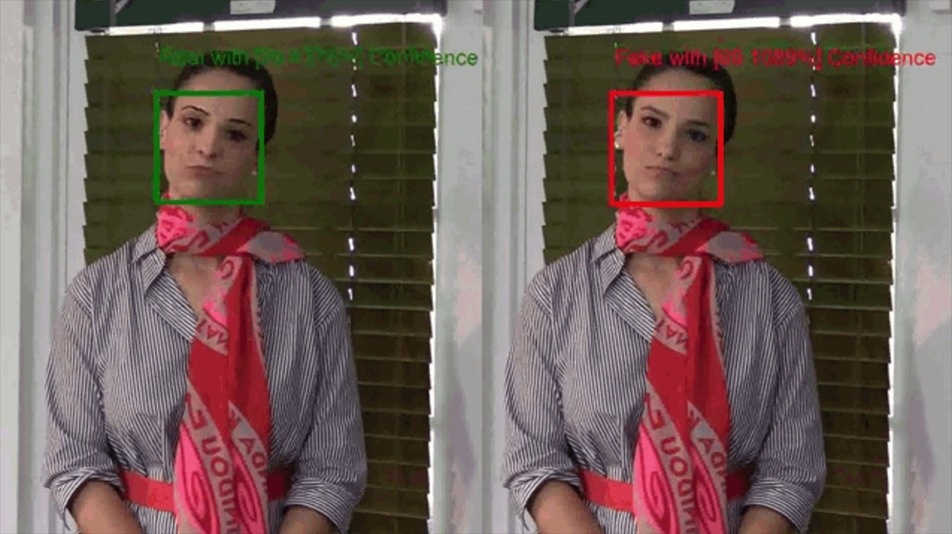

| Microsoft Video Authenticator phân tích từng khung ảnh để phát hiện sự can thiệp của deepfake. Ảnh: Microsoft. |

Công cụ đầu tiên là Microsoft Video Authenticator, ứng dụng phân tích hình ảnh và video để đưa ra "tỷ lệ phần trăm, hoặc điểm tin cậy đối với khả năng nội dung bị deepfake can thiệp". Nó hoạt động bằng cách phát hiện các yếu tố được pha trộn trong hình ảnh mà mắt người không thể nhận ra như bóng mờ, thang độ xám và ranh giới.

Công cụ thứ hai là một phần của dịch vụ đám mây Azure, cho phép tác giả thêm "mã băm và chứng chỉ kỹ thuật số" vào hình ảnh hoặc video. Sau đó chúng được nhúng vào siêu dữ liệu (metadata) khi các nội dung này xuất hiện trên Internet.

Một tiện ích mở rộng của trình duyệt sẽ khớp với những hàm băm này, cung cấp cho người đọc thông tin về người tạo ra nội dung và liệu nó có bị thay đổi hay không.

Như Microsoft đã thừa nhận trên blog của mình, 2 công cụ này chưa hẳn cho kết quả chính xác hoàn toàn. Deepfake ngày càng tinh vi hơn, AI của họ cũng cần được cập nhật. Việc dùng hàm băm để xác định hình ảnh, video có bị chỉnh sửa hay không chỉ hiệu quả khi nhà sáng tạo nội dung chịu hợp tác.

Microsoft không phải là công ty duy nhất phát triển công cụ chống lại deepfake. Các mạng xã hội lớn như Facebook, Twitter và Reddit bắt đầu tìm cách ngăn chặn nội dung giả mạo do AI tạo ra, tuy nhiên vẫn chưa có giải pháp nào mang lại hiệu quả đáng kể.