Nội dung do AI đã bắt đầu có tác động chính trị, chẳng hạn như các hình ảnh và video deepfake có Tổng thống Joe Biden và cựu Tổng thống Donald Trump lan truyền trên mạng. Câu hỏi đặt ra là, điều gì sẽ xảy ra khi bất kỳ ai cũng có thể mở máy tính xách tay và nhanh chóng tạo ra một bức ảnh như thật về một chính trị gia.

Thật giả lẫn lộn vì AI

Có rất nhiều cách để tạo hình ảnh AI từ yêu cầu văn bản, chẳng hạn như DALL-E, Midjourney và Stable Diffusion. Một số công cụ, chẳng hạn như của ElevenLabs, giúp giả giọng nói.

Để tạo một video deepfake hoàn chỉnh thì khó hơn. "Dạng video AI này vẫn đòi hỏi trình độ chuyên môn khá, cũng như chuyên môn hậu kỳ để cải thiện sản phẩm đầu ra", Henry Ajder, một chuyên gia độc lập về AI, cho biết. Tuy nhiên Ajder lưu ý sẽ có các công cụ hỗ trợ giúp tạo video deepfake dễ dàng hơn trong khoảng một năm tới.

Chỉ là vấn đề thời gian trước khi xuất hiện các công cụ mà người dùng chỉ cần đưa đầu vào văn bản và AI sẽ tạo ra một video hoàn chỉnh, theo Hany Farid, giáo sư tại Trường Thông tin UC Berkeley.

|

| Hình ảnh cắt từ một video deepfake Tổng tống Mỹ Joe Biden lan truyền trên Twitter. Ảnh: VICE. |

Nếu một số lượng đáng kể hình ảnh và video deepfake lan truyền trong cuộc bầu cử, thì không khó tưởng tượng ai đó như Donald Trump chia sẻ loại nội dung này trên mạng xã hội và coi đó như sự thật để tấn công đối thủ. Một đoạn video deepfake về Tổng thống Biden nói một điều gì đó phản cảm có thể bị tung ra ngay trước cuộc bầu cử, và nhiều người có thể không bao giờ phát hiện ra đó là video AI, hoặc đến khi phát hiện thì đã quá muộn.

Ngay cả khi video deepfake không trở nên phổ biến trước cuộc bầu cử Mỹ năm 2024, tức là 18 tháng tới, thì nguy cơ của dạng nội dung này vẫn có ảnh hưởng. Khi biết rằng hình ảnh, âm thanh và video có thể bị làm giả dễ dàng, mọi người có thể sẽ mất niềm tin vào các nội dung mà họ gặp phải.

“Deepfake và AI thậm chí không cần phải tham gia vào cuộc bầu cử để gây ra sự gián đoạn, bởi vì giờ đây mọi người đã quen với ý tưởng rằng mọi nội dung đều có thể là giả mạo”, Ajder nói.

Giải pháp xác thực nội dung ít được quan tâm

Có một số giải pháp kỹ thuật đang được phát triển. Một giải pháp được gọi là C2PA, ký bằng mật mã bất kỳ nội dung nào được tạo bởi một thiết bị, chẳng hạn như điện thoại hoặc máy quay video, bao gồm thông tin về việc nội dung được ghi lại ở đâu, khi nào. Chữ ký mật mã này được giữ trên một sổ cái, và nhà sản xuất nội dung có thể chứng minh sản phẩm của mình là chân thực.

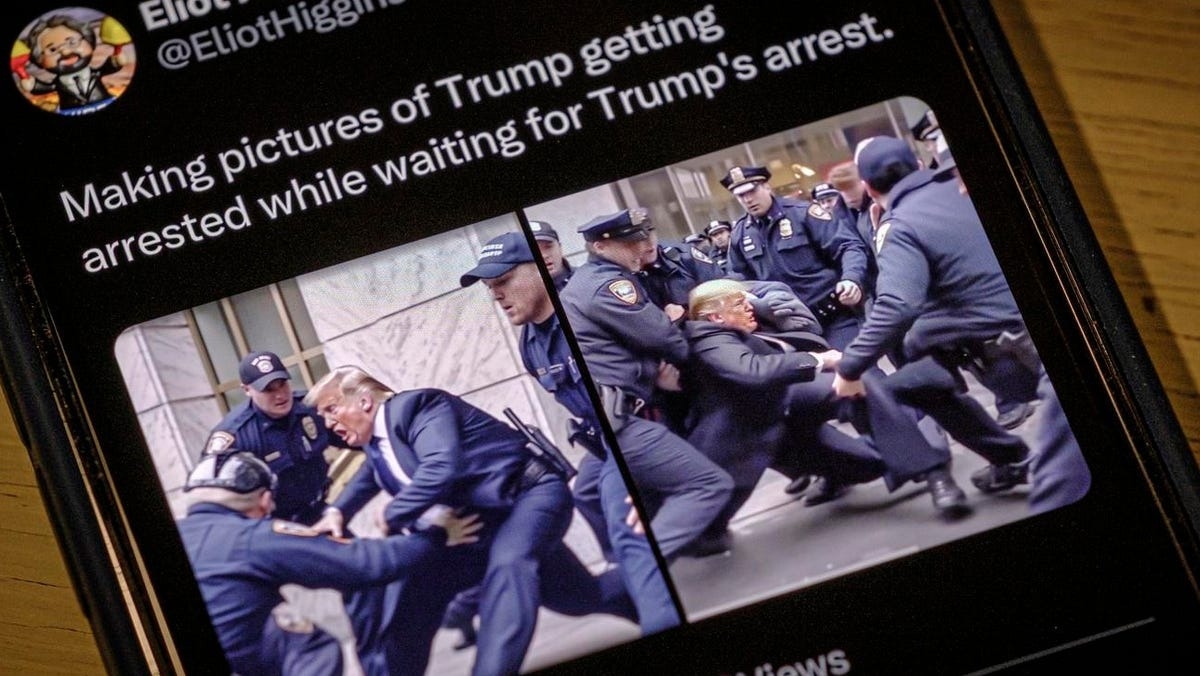

|

| Loạt ảnh deepfake Donal Trump bị bắt lan truyền trên mạng xã hội. Ảnh: AP. |

Một số giải pháp khác là đánh "dấu vân tay" và hình mờ lên hình ảnh, video. "Dấu vân tay" là chuỗi dữ liệu của một nội dung, vì vậy có thể được xác minh quá trình tạo ra là chân thực. Hình mờ thì đơn giản hơn, các công ty phát triển công cụ AI có thể tự động chèn hình mờ kỹ thuật số trên nội dung do AI tạo ra.

Một số người cho rằng sẽ có các công cụ AI giúp phát hiện deepfake, nhưng Ajder không tin tưởng vào giải pháp này, vì độ chính xác thấp và không theo kịp các công cụ AI thay đổi liên tục.

Dù vậy, đây vẫn là các giải pháp trong giai đoạn phát triển, trong khi AI tạo sinh đã là hiện thực. Nhiều công ty không nhìn thấy nhiều lợi nhuận trong việc phát triển các công cụ xác thực nội dung, theo Aviv Ovadya, một nhà nghiên cứu tại Trung tâm Internet & Xã hội Berkman Klein tại Harvard. Nhiều tiền đang được đổ vào việc phát triển AI tổng quát trong khi ít ai quan tâm đến tìm cách ngăn chặn sự lan truyền của thông tin sai do AI tạo ra.

“Chúng ta sẽ thấy vô số công cụ AI tạo sinh mới, như trong một năm qua, và nội dung chính trị do AI tạo ra sẽ tiếp tục lan truyền”, theo Ajder.

Nhân loại sẽ đối đầu với trí tuệ nhân tạo như thế nào

Trong cuốn sách "Framers - Nhân loại đối đầu nhân tạo", các tác giả nhận định con người vẫn có lợi thế trong thời đại công nghệ.